ElasticJob - 任务执行过程解析_手动调用esjob simplejob-程序员宅基地

技术标签: elasticjob Elastic-Job elastic

ElasticJob是基于Quartz实现的弹性分布式任务调度框架,整个任务触发的底层是Quartz来触发。LiteJob框架触发任务执行的开始,下面来分析任务的执行过程。

public final class LiteJob implements Job {

@Override

public void execute(final JobExecutionContext context) throws JobExecutionException {

//根据任务类型获取执行器,SimpleJobExecutor

JobExecutorFactory.getJobExecutor(elasticJob, jobFacade).execute();

}

}

ElasticJob根据任务的作业类型,获取不同的作业执行器,这里以SimpleJobExecutor为例。它继承了AbstractElasticJobExecutor,它是所有任务执行流程的模板类。

protected AbstractElasticJobExecutor(final JobFacade jobFacade) {

this.jobFacade = jobFacade;

jobRootConfig = jobFacade.loadJobRootConfiguration(true);

jobName = jobRootConfig.getTypeConfig().getCoreConfig().getJobName();

executorService = ExecutorServiceHandlerRegistry.getExecutorServiceHandler(jobName, (ExecutorServiceHandler) getHandler(JobProperties.JobPropertiesEnum.EXECUTOR_SERVICE_HANDLER));

jobExceptionHandler = (JobExceptionHandler) getHandler(JobProperties.JobPropertiesEnum.JOB_EXCEPTION_HANDLER);

itemErrorMessages = new ConcurrentHashMap<>(jobRootConfig.getTypeConfig().getCoreConfig().getShardingTotalCount(), 1);

}

在构造方法里面,是根据JobName为每个Job实例初始化了一个任务执行线程池,就是一个普通的ThreadPoolExecutor封装。下面分析下任务执行的流程:

public void execute() {

try {

//TODO 检验作业服务器和zk服务器系统时差是否可忍受,默认是不开启检查的

jobFacade.checkJobExecutionEnvironment();

} catch (final JobExecutionEnvironmentException cause) {

jobErrorHandler.handleException(jobConfig.getJobName(), cause);

}

//TODO 获取分片的上下文信息

ShardingContexts shardingContexts = jobFacade.getShardingContexts();

jobFacade.postJobStatusTraceEvent(shardingContexts.getTaskId(), State.TASK_STAGING, String.format("Job '%s' execute begin.", jobConfig.getJobName()));

//TODO 查看当前任务是否有分片正在执行,就创建节点/sharding/{item}/misfire

if (jobFacade.misfireIfRunning(shardingContexts.getShardingItemParameters().keySet())) {

jobFacade.postJobStatusTraceEvent(shardingContexts.getTaskId(), State.TASK_FINISHED, String.format(

"Previous job '%s' - shardingItems '%s' is still running, misfired job will start after previous job completed.", jobConfig.getJobName(),

shardingContexts.getShardingItemParameters().keySet()));

return;

}

try {

//TODO 任务开始执行,这里会去执行业务配置的监听器ElasticJobListener

jobFacade.beforeJobExecuted(shardingContexts);

//CHECKSTYLE:OFF

} catch (final Throwable cause) {

//CHECKSTYLE:ON

jobErrorHandler.handleException(jobConfig.getJobName(), cause);

}

//TODO 任务的执行处理

execute(shardingContexts, ExecutionSource.NORMAL_TRIGGER);

//TODO 任务是否有错过执行,重新出发调度一次

while (jobFacade.isExecuteMisfired(shardingContexts.getShardingItemParameters().keySet())) {

jobFacade.clearMisfire(shardingContexts.getShardingItemParameters().keySet());

execute(shardingContexts, ExecutionSource.MISFIRE);

}

//TODO 执行故障转移,防止未及时故障转移吧,其实有个listener在监控,为什么这里还要手动执行下 故障转移

jobFacade.failoverIfNecessary();

try {

//TODO 任务执行完成,这里是去触发业务配置的监听器的执行

jobFacade.afterJobExecuted(shardingContexts);

//CHECKSTYLE:OFF

} catch (final Throwable cause) {

//CHECKSTYLE:ON

jobErrorHandler.handleException(jobConfig.getJobName(), cause);

}

}

- Job节点服务器和zookeeper时钟差校验,对应的是Job的maxTimeDiffSeconds最大始终差配置,默认是-1不检查

try {

//TODO 检验作业服务器和zk服务器系统时差是否可忍受,默认是不开启检查的

jobFacade.checkJobExecutionEnvironment();

} catch (final JobExecutionEnvironmentException cause) {

jobErrorHandler.handleException(jobConfig.getJobName(), cause);

}

public void checkMaxTimeDiffSecondsTolerable() throws JobExecutionEnvironmentException {

int maxTimeDiffSeconds = load(true).getMaxTimeDiffSeconds();

if (-1 == maxTimeDiffSeconds) {

return;

}

long timeDiff = Math.abs(timeService.getCurrentMillis() - jobNodeStorage.getRegistryCenterTime());

if (timeDiff > maxTimeDiffSeconds * 1000L) {

throw new JobExecutionEnvironmentException(

"Time different between job server and register center exceed '%s' seconds, max time different is '%s' seconds.", timeDiff / 1000, maxTimeDiffSeconds);

}

}

- 获取当前节点服务器的分片信息,这里是分片的关键,在分片那节再细说,这里大概说下做的事情。如果Job配置了故障转移并且存在故障转移分片,优先执行从其它故障节点转移到当前节点服务器的分片。如果需要重新分片,则执行重新分片逻辑,获取分配到当前节点的分片信息。

public ShardingContexts getShardingContexts() {

boolean isFailover = configService.load(true).isFailover();

if (isFailover) {

//TODO 获取故障转移到当前节点的分片信息

List<Integer> failoverShardingItems = failoverService.getLocalFailoverItems();

if (!failoverShardingItems.isEmpty()) {

//TODO 获取故障转移分片信息

return executionContextService.getJobShardingContext(failoverShardingItems);

}

}

shardingService.shardingIfNecessary();

List<Integer> shardingItems = shardingService.getLocalShardingItems();

if (isFailover) {

//TODO 删除本节点被故障转移的分片信息

shardingItems.removeAll(failoverService.getLocalTakeOffItems());

}

shardingItems.removeAll(executionService.getDisabledItems(shardingItems));

return executionContextService.getJobShardingContext(shardingItems);

}

-

当前节点服务器该job对应的所有分片,是否有执行中的分片, 只要有一个执行中的分片,则对应的所有分片都会被设置为misfire错失执行,然后退出。 就是上次触发的执行没有完成,本次触发不会执行,会等待上次执行完成,防止任务分片在当前节点被重复执行。

//TODO 查看当前任务是否有分片正在执行,就创建节点/sharding/{item}/misfire

if (jobFacade.misfireIfRunning(shardingContexts.getShardingItemParameters().keySet())) {

jobFacade.postJobStatusTraceEvent(shardingContexts.getTaskId(), State.TASK_FINISHED, String.format(

"Previous job '%s' - shardingItems '%s' is still running, misfired job will start after previous job completed.", jobConfig.getJobName(),

shardingContexts.getShardingItemParameters().keySet()));

return;

}

public boolean misfireIfHasRunningItems(final Collection<Integer> items) {

if (!hasRunningItems(items)) {

return false;

}

//TODO 只要其中一个分片没有执行完成,就会设置misfire

setMisfire(items);

return true;

}

public boolean hasRunningItems(final Collection<Integer> items) {

JobConfiguration jobConfig = configService.load(true);

if (!jobConfig.isMonitorExecution()) {

return false;

}

for (int each : items) {

//TODO 只要其中一个分片没有执行完成,就会设置misfire

if (jobNodeStorage.isJobNodeExisted(ShardingNode.getRunningNode(each))) {

return true;

}

}

return false;

}

- 执行任务之前对应的ElasticJobListener,这个是之前在配置Job任务时对应的ElasticJobListener。

try {

//TODO 任务开始执行,这里会去执行业务配置的监听器ElasticJobListener

jobFacade.beforeJobExecuted(shardingContexts);

//CHECKSTYLE:OFF

} catch (final Throwable cause) {

//CHECKSTYLE:ON

jobErrorHandler.handleException(jobConfig.getJobName(), cause);

}

- 具体任务分片的调度执行,在分片任务执行前,在当前节点服务器把任务在内存中设置为running状态,如果配置了幂等机制,同时也会在zookeeper中创建/sharding/{item}/running临时节点,在服务器宕机该节点就会自动删除了。然后就是把所有的分片任务提交到ThreadPoolExecutor中执行。这里使用的CountDownLatch控制并发等待所有的分片任务都完成,然后就删除任务执行钱创建的/sharding/{item}/running节点。同时如果开启了故障转移机制,就会删除之前创建的故障转移节点/sharding/{item}/failover

//TODO 任务的执行处理

execute(shardingContexts, ExecutionSource.NORMAL_TRIGGER);

private void execute(final ShardingContexts shardingContexts, final ExecutionSource executionSource) {

if (shardingContexts.getShardingItemParameters().isEmpty()) {

jobFacade.postJobStatusTraceEvent(shardingContexts.getTaskId(), State.TASK_FINISHED, String.format("Sharding item for job '%s' is empty.", jobConfig.getJobName()));

return;

}

//TODO 将当前任务设置为运行中Running的状态,分为内存状态和zk状态,在zk中创建一个临时节点

jobFacade.registerJobBegin(shardingContexts);

String taskId = shardingContexts.getTaskId();

jobFacade.postJobStatusTraceEvent(taskId, State.TASK_RUNNING, "");

try {

process(shardingContexts, executionSource);

} finally {

// TODO Consider increasing the status of job failure, and how to handle the overall loop of job failure

//TODO 清除job的running状态和删除故障转移节点/sharding/{item}/failover

jobFacade.registerJobCompleted(shardingContexts);

if (itemErrorMessages.isEmpty()) {

jobFacade.postJobStatusTraceEvent(taskId, State.TASK_FINISHED, "");

} else {

jobFacade.postJobStatusTraceEvent(taskId, State.TASK_ERROR, itemErrorMessages.toString());

}

}

}

private void process(final ShardingContexts shardingContexts, final ExecutionSource executionSource) {

Collection<Integer> items = shardingContexts.getShardingItemParameters().keySet();

if (1 == items.size()) {

int item = shardingContexts.getShardingItemParameters().keySet().iterator().next();

JobExecutionEvent jobExecutionEvent = new JobExecutionEvent(IpUtils.getHostName(), IpUtils.getIp(), shardingContexts.getTaskId(), jobConfig.getJobName(), executionSource, item);

process(shardingContexts, item, jobExecutionEvent);

return;

}

CountDownLatch latch = new CountDownLatch(items.size());

for (int each : items) {

JobExecutionEvent jobExecutionEvent = new JobExecutionEvent(IpUtils.getHostName(), IpUtils.getIp(), shardingContexts.getTaskId(), jobConfig.getJobName(), executionSource, each);

if (executorService.isShutdown()) {

return;

}

executorService.submit(() -> {

try {

process(shardingContexts, each, jobExecutionEvent);

} finally {

latch.countDown();

}

});

}

try {

latch.await();

} catch (final InterruptedException ex) {

Thread.currentThread().interrupt();

}

}

- 检查是否有任务分片错过执行,这里的判断是开启了misfire任务错过机制并且分片存在/sharding/{item}/misfire节点。如果开启了任务错过机制,并且有任务错过执行,这里会重新执行一次分片节点任务。任务执行之前清除了/sharding/{item}/misfire节点。

//TODO 任务是否有错过执行,重新出发调度一次

while (jobFacade.isExecuteMisfired(shardingContexts.getShardingItemParameters().keySet())) {

jobFacade.clearMisfire(shardingContexts.getShardingItemParameters().keySet());

execute(shardingContexts, ExecutionSource.MISFIRE);

}

- 在这里再手动执行下故障转移操作, 在这里不知道为啥还需要手动执行下故障转移,在故障转移监听器里面就能监听到,为啥这里还要在任务执行的时候再手动触发下???没太理解

//TODO 执行故障转移,防止未及时故障转移吧,其实有个listener在监控,为什么这里还要手动执行下 故障转移

jobFacade.failoverIfNecessary();

- 任务分片执行完之后,触发业务给任务配置的监听器的执行

try {

//TODO 任务执行完成,这里是去触发业务配置的监听器的执行

jobFacade.afterJobExecuted(shardingContexts);

//CHECKSTYLE:OFF

} catch (final Throwable cause) {

//CHECKSTYLE:ON

jobErrorHandler.handleException(jobConfig.getJobName(), cause);

}

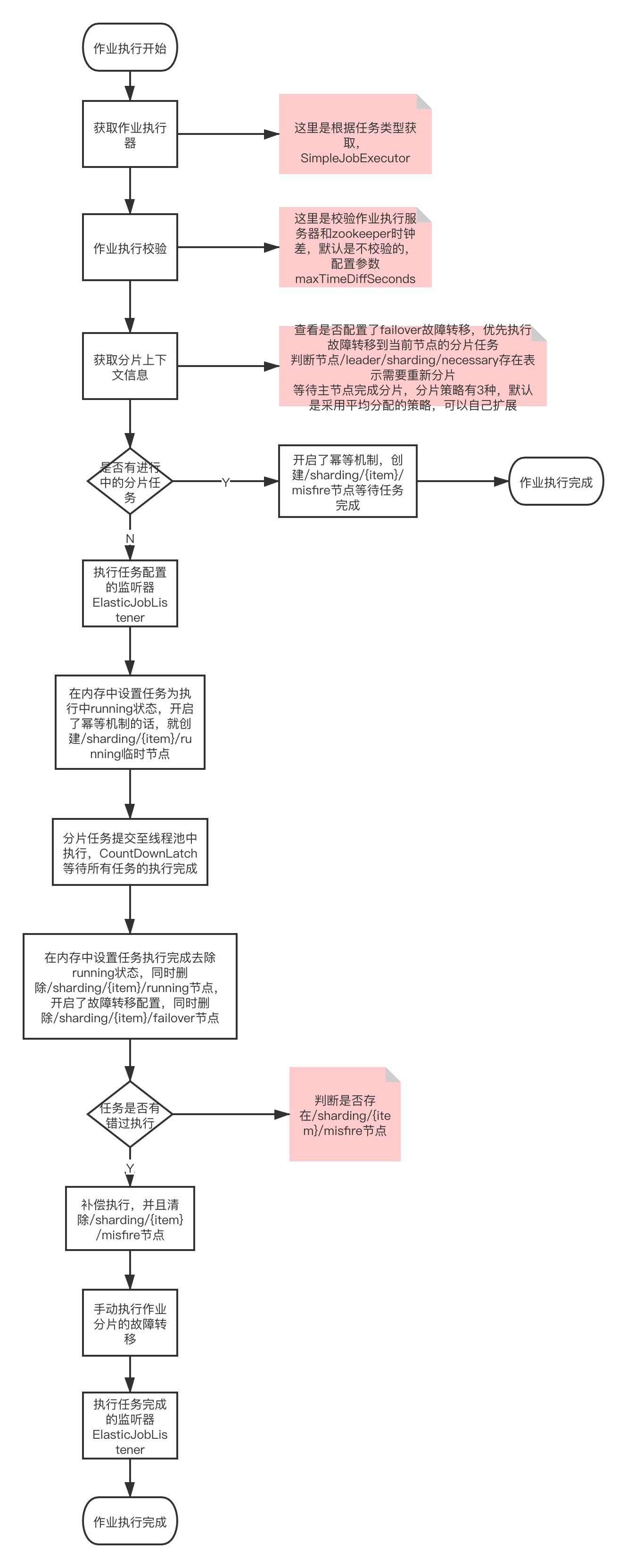

作业执行流程图:

ElasticJob作业执行流程图

智能推荐

《第一行代码》(第二版)广播的问题及其解决_代码里的广播错误-程序员宅基地

文章浏览阅读2.6k次,点赞5次,收藏13次。1)5.2.1弹出两次已连接或者未连接这是因为你同时打开了流量和WiFi,他就会发出两次广播。2)5.3.1中发送自定义广播问题标准广播未能弹出消息:Intent intent=new Intent("com.example.broadcasttest.MY_BROADCAST");sendBroadcast(intent);上述已经失效了。修改:Intent intent=new Intent("com.example.broadcasttest...._代码里的广播错误

K8s 学习者绝对不能错过的最全知识图谱(内含 58个知识点链接)-程序员宅基地

文章浏览阅读249次。作者 |平名 阿里服务端开发技术专家导读:Kubernetes 作为云原生时代的“操作系统”,熟悉和使用它是每名用户的必备技能。本篇文章概述了容器服务 Kubernet..._k8知识库

TencentOS3.1安装PHP+Nginx+redis测试系统_tencentos-3.1-程序员宅基地

文章浏览阅读923次。分别是etc/pear.conf,etc/php-fpm.conf, etc/php-fpm.d/www.conf,lib/php.ini。php8安装基本一致,因为一个服务期内有2个版本,所以注意修改不同的安装目录和端口号。可以直接使用sbin下的nginx命令启动服务。完成编译安装需要gcc支持,如果没有,使用如下命令安装。安装过程基本一致,下面是安装7.1.33的步骤。执行如下命令,检查已经安装的包和可安装的包。执行如下命令,检查已经安装的包和可安装的包。执行如下命令,检查已经安装的包和可安装的包。_tencentos-3.1

urllib.request.urlopen()基本使用_urllib.request.urlopen(url)-程序员宅基地

文章浏览阅读3.1w次,点赞21次,收藏75次。import urllib.requesturl = 'https://www.python.org'# 方式一response = urllib.request.urlopen(url)print(type(response)) # <class 'http.client.HTTPResponse'># 方式二request = urllib.request.Req..._urllib.request.urlopen(url)

如何用ChatGPT+GEE+ENVI+Python进行高光谱,多光谱成像遥感数据处理?-程序员宅基地

文章浏览阅读1.5k次,点赞12次,收藏15次。如何用ChatGPT+GEE+ENVI+Python进行高光谱,多光谱成像遥感数据处理?

RS485总线常识_rs485 差分走綫間距-程序员宅基地

文章浏览阅读1.2k次。RS485总线常识 2010-10-12 15:56:36| 分类: 知识储备 | 标签:rs485 总线 传输 差分 |字号大中小 订阅RS485总线RS485采用平衡发送和差分接收方式实现通信:发送端将串行口的TTL电平信号转换成差分信号A,B两路输出,经过线缆传输之后在接收端将差分信号还原成TTL电平信号。由于传输线通常使用双绞线,又是差分传输,所_rs485 差分走綫間距

随便推点

移植、制作uboot、Linux(一)_uboot制作-程序员宅基地

文章浏览阅读621次。u-boot、linux烧录_uboot制作

windows下安装git和gitbash安装教程_64-bit git for windows setup.-程序员宅基地

文章浏览阅读1.2w次,点赞10次,收藏44次。windos上git安装,git bash安装_64-bit git for windows setup.

环形链表(算法java)_java 实现环形链表-程序员宅基地

文章浏览阅读196次。环形链表(算法java)的两种解决方法_java 实现环形链表

docker部署Airflow(修改URL-path、更换postgres -->myslq数据库、LDAP登录)_airflow docker-程序员宅基地

文章浏览阅读5.7k次。Airflow什么是 Airflow?Airflow 的架构Airflow 解决哪些问题一、docker-compose 安装airflow(postgres)1、创建启动文件airflow-docker-compose.yml.1.1、添加挂载卷,需要修改airflow-docker-compose.yml的位置2、创建本地配置文件airflow.cfg2.1、如果想修改WEB URL地址,需要修改airflow.cfg中以下两个地方3、之后up -d直接启动即可web访问地址:二、存储数据库更换post_airflow docker

计算机毕业设计springboot高校教务管理系统532k79【附源码+数据库+部署+LW】-程序员宅基地

文章浏览阅读28次。选题背景:随着社会的发展和教育的普及,高校教务管理系统在现代高等教育中扮演着至关重要的角色。传统的手工管理方式已经无法满足高校日益增长的规模和复杂的管理需求。因此,开发一套高效、智能的教务管理系统成为了当今高校管理的迫切需求。选题意义:高校教务管理系统的开发具有重要的意义和价值。首先,它可以提高高校教务管理的效率和准确性。通过自动化处理学生选课、排课、考试安排等繁琐的事务,大大减轻了教务人员的工作负担,提高了工作效率。同时,系统可以实时更新学生信息和课程信息,减少了数据错误和冗余,保证了管理的准确性

javaint接收float_Java Integer转换double,float,int,long,string-程序员宅基地

文章浏览阅读132次。首页>基础教程>常用类>常用 Integer类Java Integer转换double,float,int,long,stringjava中Integer类可以很方便的转换成double,float,int,long,string等类型,都有固定的方法进行转换。方法double doubleValue() //以 double 类型返回该 Integer 的值。flo..._java integet接收float类型的参数