”SparkSQL物理执行计划各操作实现“ 的搜索结果

把优化后的逻辑执行计划映射到物理执行操作类这部分由SparkStrategies类实现,内部基于Catalyst提供的Strategy接口,实现了一些策略,用于分辨logicalPlan子类并替换为合适的SparkPlan子类。SparkPlan继承体系如下。...

【Spark精讲】一文讲透SparkSQL物理执行计划,SparkPlan,LeafExecNode类型,BinaryExecNode类型

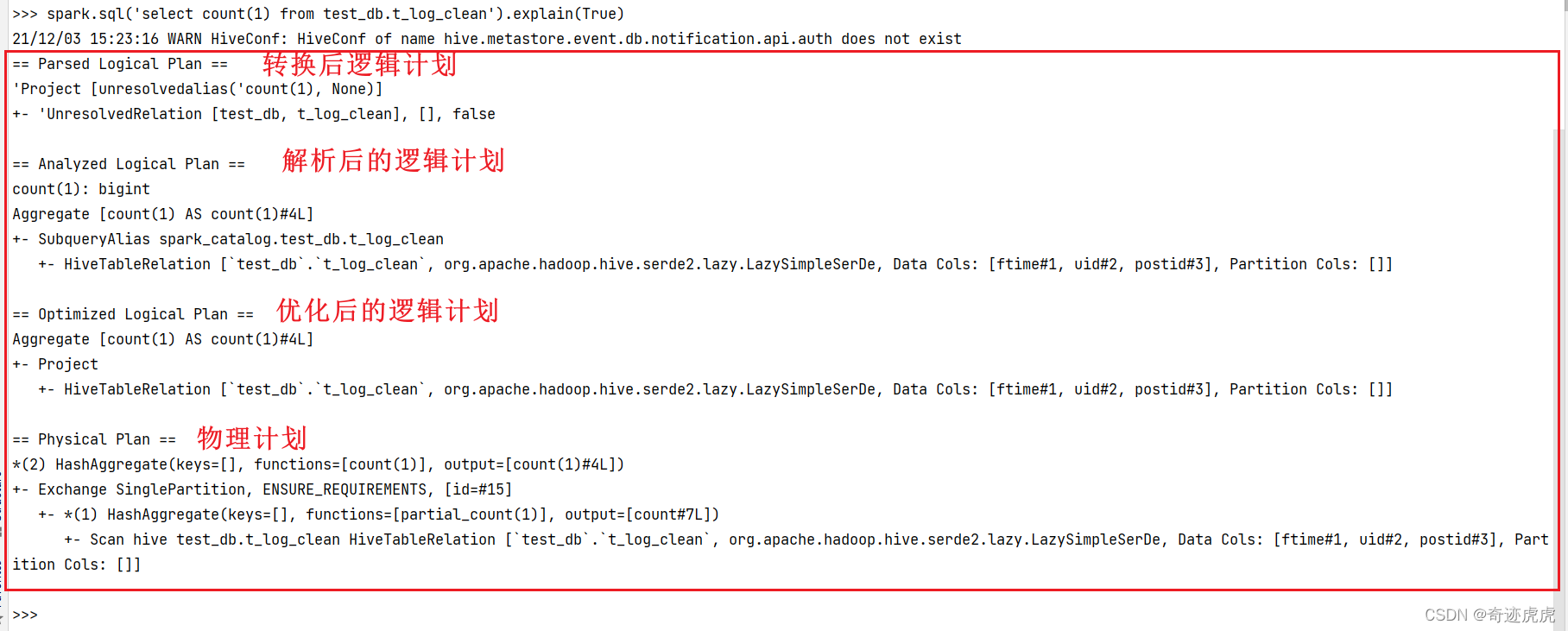

逻辑计划是SQL语句经过解析后的逻辑执行计划,它描述了SQL语句的执行顺序和数据处理方式,但不包含具体的物理实现。 以下是查看执行计划的示例: ```scala val df = spark.sql("SELECT name, age FROM people ...

物理优化则是将逻辑计划转换为物理计划,即将逻辑操作转换为 Spark 中的物理操作。 4. 生成执行计划(Execution Plan),即将物理计划转换为 Spark 中的 RDD DAG(有向无环图),并将其提交给 Spark 引擎执行。 5....

【Spark精讲】一文讲透SparkSQL执行过程,未解析的逻辑算子树,解析后的逻辑算子树,优化后的逻辑算子树,物理算子树,QueryPlan、LogicalPlan,SparkPlan,SparkSqlParser、AstBuilder、Analyzer、Optimizer

一条 SQL 在 Apache Spark 之旅(中) 在《一条 SQL 在 Apache Spark 之旅(上)》文章中我们介绍了一条 SQL 在 ApacheSpark之旅的 Parser ...在前文的绑定逻辑计划阶段对 Unresolved LogicalPlan 进行相关 transf...

mid=2247484129&idx=1&sn=28c104de4f036fc327b07f3b333ebef5&chksm=eb2e6ff0dc59e6e6057fbe421b7a96ab720d875a3937b505771cf1fe4bfac24d91dcda3cb2dc&token=2032349695&...scene=21#w

生成物理计划后,一条SQL语句就变成了可以执行的Spark任务。将逻辑计划转换成物理计划的抽象类叫做QueryPlanner,它定义了转换的框架:首先得到一系列候选物理计划、然后自底向上替换算子树节点的物理计划、最后...

Apache Spark SQL 使用 Catalyst 优化器来生成逻辑执行计划和物理执行计划。逻辑执行计划描述了逻辑上如何执行查询,而物理执行计划则是 Spark 实际执行的步骤。

从Spark SQL 底层架构可以看到,我们写的SQL语句,经过一个优化器(Catalyst),转化为RDD,交给集群执行。SQL到RDD中间经过了一个Catalyst,它就是Spark SQL的核心,是针对Spark SQL语句执行过程中的查询优化框架,...

主要介绍了sparksql执行计划查看,参数优化,SQL优化(HIVE适用)等内容

2019独角兽企业重金招聘Python工程师标准>>> ...

从SQL的解析、执行与调优到Sparksql的解析与应用 ...如下图所示,sql语句被语法解析(SQL AST)成查询计划,或者我们通过Dataset/DataFrame提供的APIs组织成查询计划,查询计划分为两大类:逻辑计划和物理计划,

Spark SQL执行的总体流程 我们知道SparkSQL最终会把API和SQL语句转换成Spark Core的RDD代码来执行。那么这个转换过程是怎样的呢?本文介绍可执行代码生成的...(5) 优化物理执行计划 (6) 生成可执行代码 在物理规划阶段

上文Spark SQL 内部原理中介绍的 Optimizer 属于 RBO,实现简单有效。它属于 LogicalPlan 的优化,所有优化均基于 LogicalPlan 本身的特点,未考虑数据本身的特点,也未考虑算子本身的代价。 本文将介绍 CBO,它充....

Spark SQL支持在Spark中执行SQL,或者HiveQL的关系查询表达式。列式存储的类RDD(DataSet/DataFrame)数据类型以及对sql语句的支持使它更容易上手,同时,它对数据的抽取、清洗的特性,使它广泛的用于etl,甚至是机器...

推荐文章

- Android 编译so文件 MP4V2_android下编译mp4v2-程序员宅基地

- 通讯录Contact_02_contact文件内容-程序员宅基地

- Qt笔记(四十二)之QZXing的编译 配置 使用_qzxingfilterrunnable error:-程序员宅基地

- 关于画图软件Dia打开程序始终为英文界面的问题-程序员宅基地

- OpenCV从入门到精通实战(二)——文档OCR识别(tesseract)-程序员宅基地

- 详解avcodec_receive_packet 11_avcodec_receive_packet eagain-程序员宅基地

- OpenGL SuperBible 7th源码编译记录_superbible7-media github-程序员宅基地

- Wireshark简单使用-程序员宅基地

- MXNet 粗糙的使用指南_iou loss mxnet-程序员宅基地

- iOS对ipa包进行代码混淆《二》 ---代码混淆_ipa包混淆-程序员宅基地