对陈天奇团队的开源深度学习编译器TVM很感兴趣,特别是看到18年发的论文中提到的在FPGA上的部署。对于基础知识薄弱(如体系架构编译等方面)的学生,应该如何学习TVM的代码呢? 如提问有误请指正,求轻喷。 相关链接...

”TVM深度学习编译器“ 的搜索结果

为了更好地满足这些需求,许多深度学习框架被开发出来,其中TVM(TVirtual Machine)是一种优秀的编译器,能够将深度学习模型编译为高效的机器码。而且TVM编译器的核心思想,就是将深度学习模型转化为高效的计算图,...

本文来自AI新媒体量子位(QbitAI) △陈天奇,华盛顿大学计算机系博士生,此前毕业于上海交通大学ACM班...所谓TVM,按照正式说法:就是一种将深度学习工作负载部署到硬件的端到端IR(中间表示)堆栈。换一种说法...

随着深度学习技术的发展,大模型已经成为深度学习的未来。大模型是一种深度学习模型,它可以处理大量的数据,从而获得准确的预测结果。首先,大模型可以有效地处理大量数据。传统的机器学习模型只能处理少量的数据,...

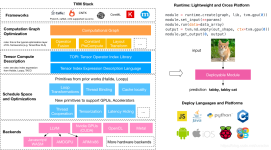

随着深度学习模型和硬件后端数量的增加,TVM构建了一种基于中间表示 (IR)的统一解决方案。TVM不仅能自动优化深度学习模型,还提供了跨平台的高效开源部署框架。(Tensor Virtual Machine, 张量虚拟机)是一种开源的...

更多关于 RTP 系统的介绍请见 深度预测平台RTP介绍 背景简介 RTP 系统 RTP 系统(即 Rank Service),是一个面向搜索和推荐的 ranking 需求,支持多种模型的在线 inference 服务。RTP 支持 LR、GBDT 以及 tensorflow ...

在结束之际,我想重申的是,学习并非如攀登险峻高峰,而是如滴水穿石般的持久累积。尤其当我们步入工作岗位之后,持之以恒的学习变得愈发不易,如同在茫茫大海中独自划舟,稍有松懈便可能被巨浪吞噬。然而,对于我们...

TVM:一个端到端的用于开发深度学习负载以适应多种硬件平台的IR栈 本文对TVM的论文进行了翻译整理 深度学习如今无处不在且必不可少。这次创新部分得益于可扩展的深度学习系统,比如TensorFlow、MXNet、Caffe和...

【翻译】深度学习框架简史(A Brief History of Deep Learning Frameworks) 原文链接:https://towardsdatascience.com/a-brief-history-of-deep-learning-frameworks-8debf3ba6607 作者:Lin Yuan Machine Learning...

优化时间(s)default2.930760+tile0.261980+vectorize0.16041+parallel0.025833。

2023 Meet TVM 线下聚会第 3 站将于 9 月 16 日在深圳腾讯大厦举办!本次 Meetup 包含 5 个关于 AI 编译器的精彩 talk,期待与大家在深圳相聚!

深度学习框架计算平台的初识

标签: 深度学习

TVM:Linux源码编译安装 笔者环境: OS:Ubuntu 18.04 CMake:3.10.2 gcc:7.5.0 cuda:11.1 编译安装过程总览 本文将简介 tvm 的编译安装过程,包含两个步骤: 通过C++代码构建共享库 设置相关的语言包(如...

记录调研TVM框架的过程和结论

tvm是深度学习编译器,它可以把神经网络模型编译成动态库,然后部署到多种硬件上,包括各种端侧设备。 一、安装tvm 此处是在linux环境下安装tvm,通过tvm的python接口将深度学习模型编译成动态链接库,参考链接:tvm...

深度学习模型部署浅析

标签: 模型部署

关于模型部署可能有很多种概念或者解释。 根据看的一些文献和接触的一些开源工具,进行梳理。 模型部署说到底,就是通信传输,以及平台存储打通,以及任务的定时工作(定时工作可能偏向于调度了)。...

【TVM学习一】About TVM

标签: TVM

TVM是一个用于CPU, GPU和专用加速器的开放式深度学习编译器堆栈。它旨在缩小以生产力为重点的深度学习框架与面向性能或效率的硬件后端之间的差距。TVM提供以下主要功能: 将Kears, MxNet, Tensorflow, CoreML, ...

3月份,国内有多个深度学习框架开源,OneFlow也在为开源做最后的准备,2020是深度学习框架领域非常热闹的一年。一个框架好与不好,是有很多维度去看待的,使用者和框架开发者的关注点可能就不一样。 对于绝大部分...

随着深度学习的发展,深度学习的能力可以说是越来越强大,识别率节节攀升,与此同时,深度学习框架也变得越来越多,目前比较主流的深度学习框架包括:Pytorch、TensorFlow、MxNet、Caffe、Keras等。 一般进行深度...

推荐文章

- YOLO V8车辆行人识别_yolov8 无法识别路边行人-程序员宅基地

- jpa mysql分页_Spring Boot之JPA分页-程序员宅基地

- win10打印图片中间空白以及选择打印机预览重启_win10更新后打印图片中间空白-程序员宅基地

- 【加密】SHA256加盐加密_sha256随机盐加密-程序员宅基地

- cordys 启动流程_cordys服务重启-程序员宅基地

- net中 DLL、GAC-程序员宅基地

- (一看就会)Visual Studio设置字体大小_visual studio怎么调整字体大小-程序员宅基地

- Linux中如何读写硬盘(或Virtual Disk)上指定物理扇区_dd写入确定扇区-程序员宅基地

- python【力扣LeetCode算法题库】面试题 17.16- 按摩师(DP)_一个有名的讲师,预约一小时为单位,每次预约服务之间要有休息时间,给定一个预约请-程序员宅基地

- 进制的转换技巧_10111100b转换为十进制-程序员宅基地