”softmax“ 的搜索结果

sum运算符:给定一个矩阵X,我们可以对所有元素求和(默认情况下)。也可以只求同一个轴上的元素,即同一列(轴0)或同一行(轴1)。对每个项求幂(使用exp);对每一行求和(小批量中每个样本是一行),得到每个...

python版softmax: def softmax(x, axis=1): # 计算每行的最大值 row_max = x.max(axis=axis) # 每行元素都需要减去对应的最大值,否则求exp(x)会溢出,导致inf情况 row_max = row_max.reshape(-1, 1) x = x -...

softmax回归和线性回归一样也是将输入特征与权重做线性叠加,但是softmax回归的输出值个数等于标签中的类别数,这样就可以用于预测分类问题。分类问题和线性回归的区别:分类任务通常有多个输出,作为不同类别的置信...

Softmax以及Sigmoid这两者都是神经网络中的激活函数,对应还有其他的激活函数引入激活函数是为了将其输入非线性化,使得神经网络可以逼近任何非线性函数(原本没有引入激活函数,就是多个矩阵进行相乘,无论神经网络...

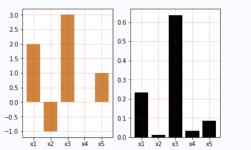

Softmax是一种常用的分类函数,它将一个n维向量(通常用于表示某个实体的特征向量)输入,并将其标准化为一个n维概率分布,其中每个元素的值都介于0和1之间,并且所有元素的和为1。softmax函数通过将n维向量z的每个...

softmax求导过程详解

标签: softmax

使用于想要了解softmax的人群

Softmax是逻辑回归的一种推广,可以用于多分类任务,其公式与逻辑回归的sigmoid函数非常相似。Softmax是一种数学函数,通常用于将一组任意实数转换为表示概率分布的实数。其本质上是一种归一化函数,可以将一组任意...

Softmax 函数的数学原理分析和 PyTorch 使用

这几天学习了一下softmax激活函数,以及它的梯度求导过程,整理一下便于分享和交流! softmax函数 softmax用于多分类过程中,它将多个神经元的输出,映射到(0,1)区间内,可以看成概率来理解,从而来进行多分类...

softmax_variants softmax变体的各种损失函数:中心损失,余面损失,高边距高斯混合,由pytorch 0.3.1实现的COCOLoss 训练数据集是MNIST 您可以直接运行代码train_mnist_xxx.py重现结果 参考文件如下: 中锋失利...

对数几率回归解决的是二分类的问题, 对于多个选项的问题,我们可以使用softmax函数,它是对数几率回归在 N 个可能不同的值上的推广。 神经网络的原始输出不是一个概率值,实质上只是输入的数值做了复杂的加权和...

matlab求导代码Log-sum-exp和softmax函数 关于 logsumexp和softmax评估log-sum-exp函数$ lse(x)= log ∑ i = 1 ^ ne x_i $和softmax函数$ g(x)$,其中$ g_j(x)= \ frac {e x_j } { ∑ i = 1 ^ ne x_i $,其中x...

AmSoftmax pytorch实现代码

使用softmax解决三分类问题,梯度下降法,数据集为鸢尾花数据集。

在利用torch.max函数和F.Ssoftmax函数时,对应该设置什么维度,总是有点懵,遂总结一下: 首先看看二维tensor的函数的例子: import torch import torch.nn.functional as F ...b = F.softmax(inp

智能优化算法、神经网络预测、信号处理、元胞自动机、图像处理、路径规划、无人机等多种领域的Matlab仿真代码

Softmax 函数用于多分类,他将多个神经元的输出的值映射到(0,1)区间内的一个值,,并且映射的所有值相加为1,这些值可以理解为输出的概率,输出概率较大的一般作为预测的值 计算公式 分子:fyi 表示第i个类别指数...

该软件包提供entmax和entmax损失的pytorch实现:稀疏的概率映射族和相应的损失函数,概括了softmax /交叉熵。 特征: 精确的部分排序算法,用于1.5-entmax和2-entmax(sparsemax)。 通用alpha-entmax的基于二...

RBF-Softmax

标签: Python

用编写并从修改过的RBF-Softmax项目。 在RBF-Softmax中,对数由RBF内核计算,然后由超参数缩放。 因此,此处将最后一个FC中的权重视为类原型。 RBF-Softmax管道 MNIST玩具演示可视化的RBF-Softmax和其他损失。 ...

主要介绍了Softmax函数原理及Python实现过程解析,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友可以参考下

复制的Softmax模型 在论文“复制的softmax:无向主题模型”中重复实验。 Preprocess.py:在此库中,您可以读取文件并删除停用词,标点符号和词干标记。 然后获得最多K个频繁令牌。 并计算字典,语料库,doc-word...

softmax-splatting这是softmax splatting运算符的参考实现,已在使用PyTorch的用于视频帧插值的Softmax splatting [1]中提出。 Softmax喷溅是一种有积极性的方法,可用于区分前向翘曲。它使用平移不变重要性度量来...

数据集列表cner:数据集/ cner 主持人: : 型号清单BERT + Softmax BERT + CRF BERT +跨度需求1.1.0 = <PyTorch <1.5.0 cuda = 9.0 python3.6 +输入格式输入格式(首选BIOS标记方案),每个字符的标签为一行...

在计算loss的时候,最常见的一句话就是tf.nn.softmax_cross_entropy_with_logits,那么它到底是怎么做的呢? 首先明确一点,loss是代价值,也就是我们要最小化的值 tf.nn.softmax_cross_entropy_with_logits(logits,...

我实现的标签平滑,amsoftmax,焦点损耗,双焦点损耗,三重态损耗,giou损耗,亲和力损耗,pc_softmax_cross_entropy,ohem损耗(基于行硬挖掘损失的softmax),大利润- softmax(bmvc2019),lovasz-softmax-loss和...

基于softmax+k折验证的iris数据分类 pytorch实现

推荐文章

- 大数据技术未来发展前景及趋势分析_大数据技术的发展方向-程序员宅基地

- Abaqus学习-初识Abaqus(悬臂梁)_abaqus悬臂梁-程序员宅基地

- 数据预处理--数据格式csv、arff等之间的转换_csv转arff文件-程序员宅基地

- c语言发送网络请求,如何使用C+发出HTTP请求?-程序员宅基地

- ccc计算机比赛如何报名,整理:加拿大的CCC是什么,怎么报名?-程序员宅基地

- RK3568 学习笔记 : ubuntu 20.04 下 Linux-SDK 镜像烧写_rk3568刷linux-程序员宅基地

- Gradle是什么_gradle是干嘛的-程序员宅基地

- adb命令集锦-程序员宅基地

- 【Java基础学习打卡15】分隔符、标识符与关键字_java分隔符有哪三种-程序员宅基地

- Python批量改变图片名字_python批量修改图片名称-程序员宅基地