”模型微调“ 的搜索结果

第三范式:基于预训练模型 + fine-tuning的范式,如 BERT + finetuning 的NLP任务,相比于第二范式,模型准确度显著提高,但是模型也随之变得更大,但小数据集就可训练出好模型; 第四范式:基于预训练模型 + Prompt...

百川大模型微调,lora模型,训练模型,大语言模型,Baichuan-7B模型微调,百川大模型量化 int量化 INT4量化微调模型,Baichuan-7B模型量化 百川模型量化 Baichuan-7B 是由百川智能开发的一个开源可商用的大规模预...

模型微调(Fine-tuning)作为一种迁移学习技术,通过在预训练模型的基础上进行少量参数调整,使其适应特定任务,成为了深度学习应用中的重要手段。模型微调是深度学习应用中的重要技术,它可以帮助我们快速构建高...

感性理解:大模型微调指的是“喂”给模型更多信息,对模型的特定功能进行 “调教”,即通过输入特定领域的数据集,让其学习这个领域的知识,从而让 大模型能够更好的完成特定领域的NLP任务,例如情感分析、命名实体...

微调大模型方法最全综述各种各样的微调模型在最近两三年很火爆,想要去讲明白这些方法并不容易~但是我还是想尝试一下,尽可能将这些微调模型以一个清晰的架构呈现出来。

微调的目标是在较小的目标数据集上,通过有限的训练数据,使模型更好地适应特定任务,从而提高模型在该任务上的性能。然而,微调也需要小心处理,以避免过拟合和破坏预训练模型的特征。在图像分类、物体检测、图像...

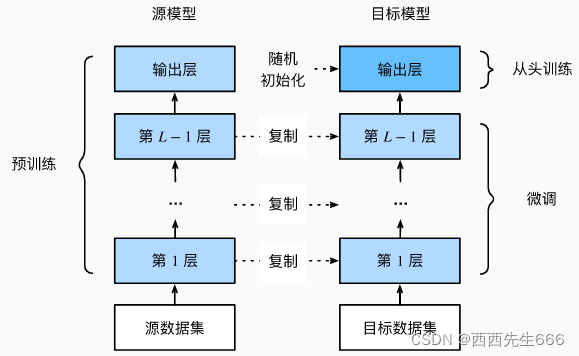

模型微调(fine-tuning)是一种迁移学习方法,在不修改网络结构、直接对其最后几层的参数进行微调的同时,保留原网络前面的层参数不变,达到提升模型性能的目的。因此,模型微调非常适用于现有任务的相关领域、数据...

保存时只需要为每个任务保存重参数的结果即可。

感性理解:大模型微调指的是“喂”给模型更多信息,对模型的特定功能进行 “调教”,即通过输入特定领域的数据集,让其学习这个领域的知识,从而让 大模型能够更好的完成特定领域的NLP任务,例如情感分析、命名实体...

感性理解:大模型微调指的是“喂”给模型更多信息,对模型的特定功能进行 “调教”,即通过输入特定领域的数据集,让其学习这个领域的知识,从而让 大模型能够更好的完成特定领域的NLP任务,例如情感分析、命名实体...

模型微调(fine-tune)

模型微调微调:了解如何将机器学习模型优化到更高的性能 作为一名人工智能专家,模型微调微调是一个非常重要的技术,它可以帮助我们构建更高效的机器学习模型,从而提高我们的预测准确性和数据处理速度。在本文中,...

chatglm使用lora进行模型微调训练,没有采用官方的方案,使用了另一种效果好的方案,对于显存特别友好,24g显存就能训练自己的垂直领域大模型训练了,效果还是非常的好的,适合自己机器不是很多的需要做实验的同学

随着人工智能技术的快速发展,大型企业纷纷投入到大型模型(如大语言模型、多模态大模型等)的研发与应用中。...企业在实施大模型微调项目时,往往面临着一系列挑战,如技术选型、团队组建、职责分工不明确等问题。

本文深入讲解了大模型巨作:《ChatGLM3大模型本地化部署、应用开发与微调》,希望能对学习大模型的同学们有所帮助。 文章目录 1. 前言 2. 书籍推荐 2.1 内容简介 2.2 本书作者 2.3 本书目录 2.4 适合读者 3. ...

微调,就是基于预训练模型进行微调,比如用大型数据集Imagenet训练好的resnet,再在自己的数据集上训练一部分靠近输出的层,使之更加适用于自己的问题。预训练模型的数据集与自己的数据集相似,但自己的数据集太少...

在极客时间AI大模型微调训练营的学习经历让我实现了对AI趋势的深刻理解和微调技术的实践应用。作为AI业务落地和产品平台提效的专业人员,我通过这门课程深化了对AI技术发展浪潮的认识,掌握了大模型的核心技术,如...

八、大模型微调数据构造

标签: 大模型

self-instruct:种子数据+AI 生成建立文件夹ruozhiba上传处理后的弱智吧数据,首先新建data文件夹:然后将处理过的训练集train.jsonl和测试集test.jsonl上传到该路径下。

距离ChatGPT已经发布1年半了,距离我们训练出自己的大模型也已经1周年了。目前仍然有很多同学在咨询如何训练自己的大模型。这个东西和男/女朋友一样。当你不认识TA,距离TA很远,不敢接触TA的时候,TA就是很神秘,也...

人工智能大语言模型微调技术:SFT 监督微调、LoRA 微调方法、P-tuning v2 微调方法、Freeze 监督微调方法

大模型微调的主要步骤包括:1.准备数据集收集数据:获取与特定任务相关的数据集。数据清洗:清理数据,移除噪声和不一致性。标注:确保数据集包含正确的标签,对于无监督任务则不需要。分割:将数据集划分为训练集、...

大家千万不要以为大模型微调之后就完全按照你的意思回答了。

深度学习微调⽅法⾮常多,主流⽅法包括LoRA、Prefix Tuning、P- Tuning、Promt Tuning、AdaLoRA等;目前这些⽅法的实现均已集成⾄Hugging Face项⽬的库中,我们可以通过安装和调HuggingFace的PEFT(⾼效微调)库,来...

系统的介绍为什么要对大模型进行微调,微调与提示词的区别,如何对大模型微调,以及如何对大模型评估。

我们讨论了这些模型的算法特点、工程实现挑战和针对性微调数据集构建的策略。强调了微调时数据质量、多样性及平衡的重要性,并通过案例展示了实际应用中的数据集准备。文章指出,有效的微调关键在于精心设计的数据集...

推荐文章

- GPT-ArcGIS数据处理、空间分析、可视化及多案例综合应用

- 在Debian 10上安装MySQL_debian mysql安装-程序员宅基地

- edge 此项内容已下载并添加到 Chrome 中。_一个小扩展,解决Chrome长期以来的大痛点...-程序员宅基地

- vue js 点击按钮为当前获得焦点的输入框输入值_vue获得当前获得焦点的元素-程序员宅基地

- Android 资源文件中@、@android:type、@*、?、@+含义和区别_@android @*android-程序员宅基地

- python中的正则表达式是干嘛的_Python中正则表达式介绍-程序员宅基地

- GeoGeo多线程_geo 多线程-程序员宅基地

- phpstudy的Apache无法启动_phpstudy apache无-程序员宅基地

- 数据泵导出出现ORA-31617错误-程序员宅基地

- java基础巩固-宇宙第一AiYWM:为了维持生计,两年多实验室项目经验之分层总结和其他后端开发好的习惯~整起_java两年经验项目-程序员宅基地